News

20.06.2018, 06:00 Uhr

Deep-Learning-Algorithmus rendert 3D-Szene aus 2D-Bildern

Wie sähe ein Foto Ihres Wohnzimmers in 3D aus? Entwickler von DeepMind haben einen Algorithmus entwickelt, der das selbstständig errechnen kann.

Wie sieht ein auf einem zweidimensionalem Bild dargestelltes Objekt dreidimensional aus? Nicht alle Menschen können sich das so genau vorstellen. Kein Problem, denn die Entwickler von DeepMind haben einen Algorithmus entwickelt, der aus 2D-Darstellungen Objekte und Räume erzeugen kann, wie das Techportal Golem schreibt.

DeepMind nennt das künstliche Bildverarbeitungssystem Generative Query Network (GQN), das die Forscher in der Fachzeitschrift «Science» vorgestellt haben. GQN ist ein Framework, in dem Maschinen lernen, ihre Umgebung wahrzunehmen, indem sie nur auf Daten trainieren, die sie selbst erhalten, wenn sie sich in Szenen bewegen.

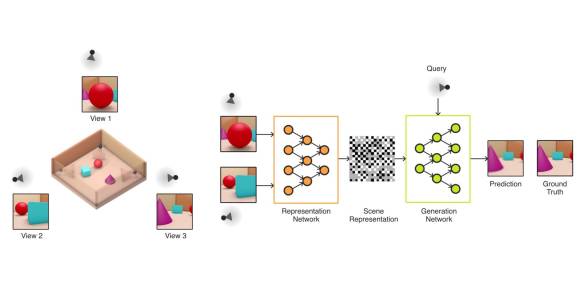

Das GQN-Modell besteht aus zwei Teilen: einem Repräsentationsnetz und einem Erzeugungsnetz. Das Repräsentationsnetzwerk nimmt die Beobachtungen des Agenten als Input und erzeugt eine Darstellung (einen Vektor), der die zugrunde liegende Szene beschreibt.

Das Erzeugungsnetz progonostiziert («imaginiert») die Szene aus einer bisher unbeachteten Perspektive. So entsteht das 3D-Bild.

GQN ahmt die Funktionsweise des menschlichen Gehirns nach. Der Algorithmus lerne ähnlich wie Säuglinge und Tiere, indem er versucht, seine Beobachtungen der Welt um sich herum zu verstehen, wie die DeepMind-Entwickler in ihrem Blog schreiben.

Im Video unten erklärt Dr. Ali Eslami, wie man einem Computer das Sehen beibringt.

Kommentare

Es sind keine Kommentare vorhanden.