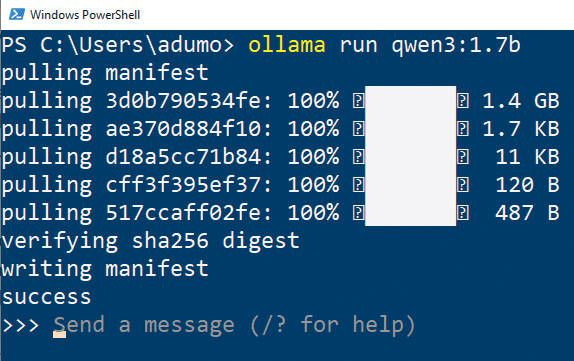

Bild 8: Um ein Modell auszuführen, geben Sie ollama run ein, gefolgt vom Modellnamen

Quelle: PCtipp.ch

Ollama funktioniert ähnlich wie LM Studio und steht für macOS, Linux und Windows bereit. Es ist ein praktisches Tool, mit dem Sie diverse Open-Source-KI-Modelle schnell einrichten. Ollama übernimmt das Herunterladen und Ausführen und verfügt sogar über eine API (Schnittstelle), mit der Sie von anderen Anwendungen aus darauf zugreifen können. Um es auszuprobieren, surfen Sie zu

ollama.com/download und laden die Windows-Version von Ollama herunter. Führen Sie die Set-up-Datei aus, um das Tool zu installieren und zu starten. Dort können Sie bereits einige KI-Modelle direkt installieren und nutzen. Oder Sie rufen die Windows-Eingabeaufforderung

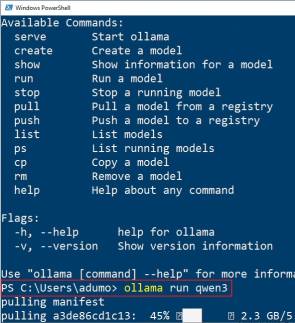

Bild 9: Bei Ollama sehen Sie auf einen Blick, welche Modellvarianten zur Verfügung stehen

Quelle: PCtipp.ch

auf. Geben Sie dort etwa

ollama pull qwen3:1.7b ein, um das entsprechende LLM herunterzuladen. Starten Sie es mit

ollama run qwen3:1.7b, Bild 8. Die Liste aller unterstützten Modelle finden Sie unter

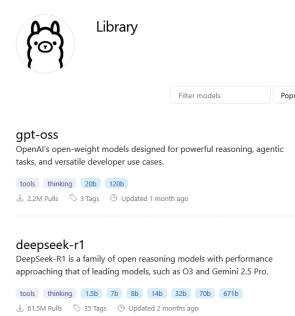

ollama.com/library. Praktisch: Anders als LM Studio zeigt Ollama die Versionen gebündelt an. So sehen Sie auf einen Blick, dass etwa von DeepSeek R1 sieben Versionen zur Auswahl stehen, Bild 9. Im Fall von

Qwen3 umfasst der Download rund 1,2 GB. Nach getaner Arbeit erscheint die Eingabeaufforderung für den Prompt, etwa «What is the most famous picture of Monet?», Bild 10. Alternativ können Sie auch Ollama starten und den Chat dort fortführen. Das ist komfortabler.

Bild 10: Der Chat erfolgt in der Windows-Eingabeaufforderung oder in der Bedienoberfläche von Ollama

Quelle: PCtipp.ch

Die meisten Modelle verstehen Deutsch. Die Ergebnisse sind aber schlechter, da nur ein Bruchteil der Trainingsdaten in Deutsch vorliegt. An

Qwen3:1.7b mit nur zwei Milliarden Parametern zeigt sich, dass weniger Parameter weniger Qualität bedeuten. Auf die Frage nach dem berühmtesten Bild von Claude Monet nennt es zwar die Seerosen, erwähnt aber auch Bilder von Renoir und anderen.

02.12.2025

03.12.2025

06.12.2025