Methoden um Deepfakes zu erkennen

Deepfakes abwehren

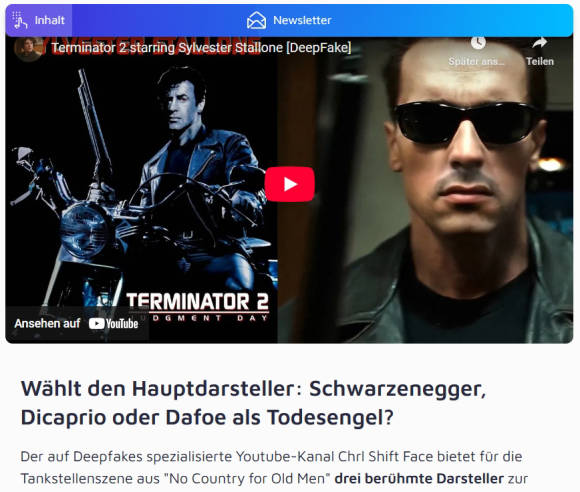

Wie gut ein Deepfake sein kann, zeigt etwa die Seite the-decoder.de, Bild 9. Dort finden sich Videos mit Sly Stallone als Terminator, generiert aus einer Originalfilmszene. Während man hier noch kleine Fehler im Video sieht, gibt es dort ebenfalls eine Szene als Biopic über Freddie Mercury. Darin wurde das Gesicht des Schauspielers Rami Malek mithilfe der KI durch das Gesicht von Freddie Mercury ausgewechselt. Die Szene sieht einfach so echt aus, dass man davon Gänsehaut bekommt. Die Webseite möchte natürlich keine Deepfakes vertreiben. Die Macher wollen nur zeigen, was alles bereits möglich ist – und das mit begrenzten Mitteln.

Bild 9: Ein Beispiel, was man mit KI machen kann – bei Fans übernimmt Sly Stalone die Rolle des Terminators

Quelle: PCtipp.ch

Aber für Unternehmen gibt es die ersten Lösungen, die Videos analysieren oder sogar Schutzmodule für Videokonferenz-Software wie Microsoft Teams anbieten. Das Interessante dabei: Einige Forschungsprojekte laufen bereits seit 2020 und früher; sie sollten Videos erkennen wegen der Gefahr der Desinformation bei Wahlen oder Kampagnen. Die Forschung wurde aber teils von der Realität überholt. Dennoch gibt es bereits einige Lösungen für Unternehmen. Das gute dabei: Fast alle Lösungen für Unternehmen kommen irgendwann auch für die breite Masse – also für Endanwender – auf den Markt.

- Sentinel: Der Security-Hersteller hat mit thesentinelai.com eine Plattform entwickelt, die auf professioneller Basis Deepfakes für Unternehmen erkennen kann.

- Attestiv: Die cloudbasierte Deepfake-Videoerkennungs-Software von Attestiv nutzt KI- und Machine-Learning-Technik (ML), um Hinweise auf Manipulationen oder synthetische Elemente in Mediendateien aufzudecken. So lassen sich online Videos hochladen und analysieren. Das Angebot richtet sich an Unternehmen und Videoproducer.

- FakeCatcher: Intel forscht an einer Lösung und hat bereits erste Demos seines FakeCatchers parat. Die Lösung soll nicht eigenständig, sondern später in eine Software integriert sein, etwa für Videokonferenzen und mehr.

- RealityDefender: Das ehemalige Forschungsprojekt ist nun ein Produkt und bietet Schutz für Unternehmen bei Videokonferenzen, in dem es Deepfakes erkennen kann.

Kommentare

Es sind keine Kommentare vorhanden.